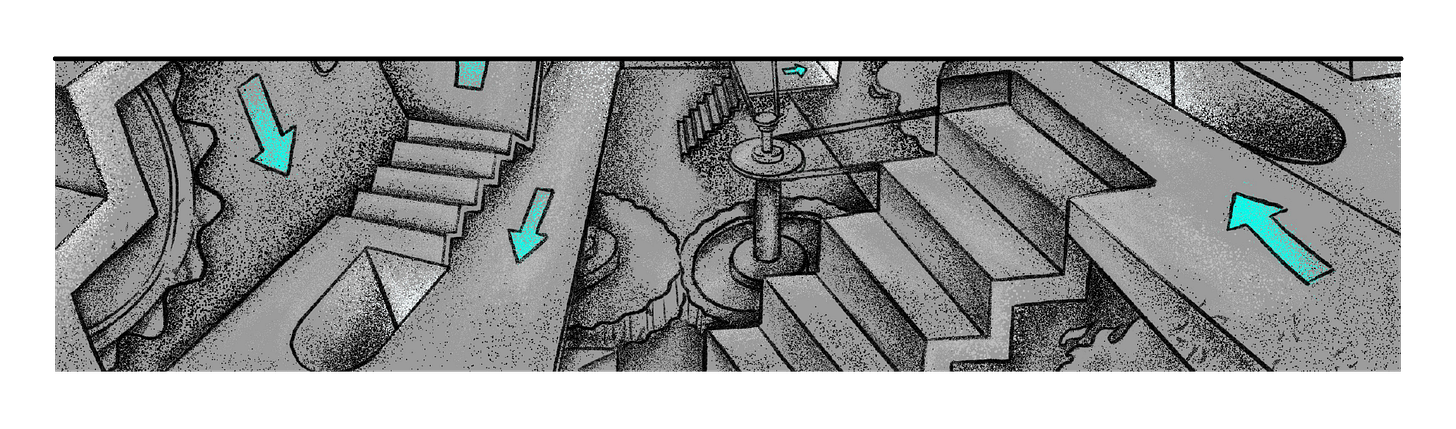

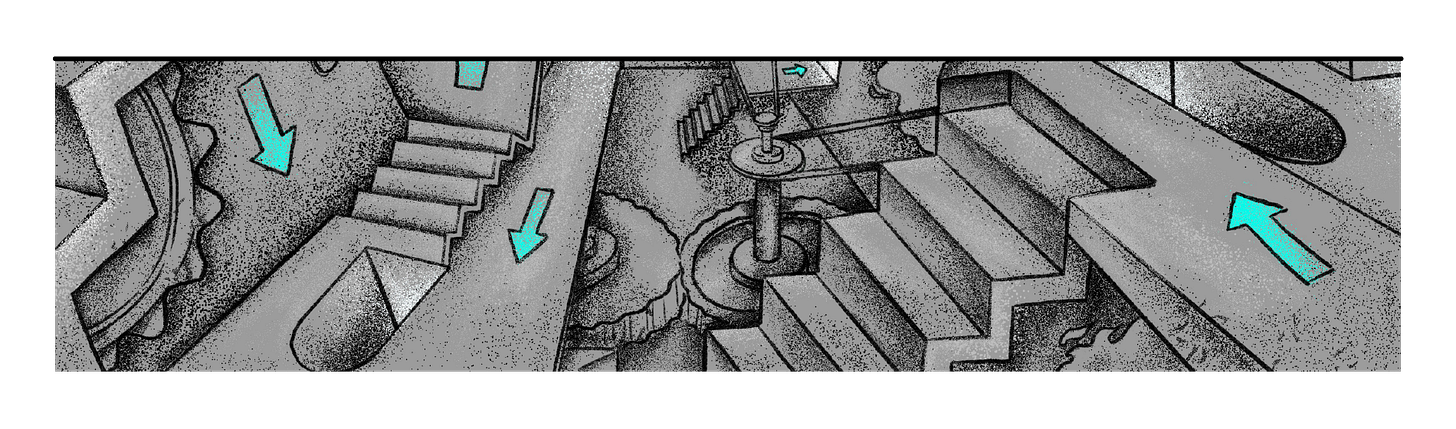

Los deepfakes y la realidad distorsionada

Las imágenes, los videos y audios creados ahora con herramientas de IA ponen a prueba nuestra capacidad de discernimiento. ¿Cómo afectará esto las elecciones en 2024 en la región? 🔎

¡Hola! Les doy la bienvenida a La Lupa Digital: Centroamérica y México, un boletín que alerta y explica el funcionamiento de la máquina de la manipulación en línea y busca herramientas para hacerle frente con inspiración 💫. Soy Laura Rodríguez Salamanca, periodista y fact-checker.

¿Han visto las fotos de Tom Cruise con sus dobles de riesgo en el lanzamiento de Misión Imposible 7? Hace unas semanas, estuve jugando a identificar cuál era el actor real entre los dos y hasta nueve hombres casi idénticos que aparecen en las imágenes. ¡Son igualitos!

En ese momento no lo sabía, pero Cruise no estaba en ninguna de las fotos 😳. Todas eran deepfakes, es decir, contenidos (imágenes, audios y videos) creados con inteligencia artificial (IA) que replican la apariencia o el sonido de una persona. No me juzguen por caer en la trampa 🙈. Los fact-checkers no verificamos las 24 horas.

Pensé que esta anécdota sería un buen tema para abrir este boletín porque los deepfakes no solo producen situaciones divertidas. ⚠️Es el momento de prestarles atención, considerando las posibles implicaciones que tiene su uso en política y en el debate público, pues la producción de réplicas con el propósito de engañarnos ya llegó a la región ⚠️.

A solo un año del lanzamiento de ChatGPT y la popularización de la IA (y de softwares para la producción y modificación de imágenes y videos), ya nos encontramos frente a contenidos cada vez más sofisticados que desafían nuestra capacidad de discernir su autenticidad.

Ahora, con solo incluir un par de instrucciones, es posible producir contenidos económicos y de calidad para una campaña digital, pero también para difundir imitaciones para difamar y confundir a la ciudadanía 😕.

Por eso, debemos prepararnos para los comicios que se avecinan en 2024: los generales en Panamá 🇵🇦, México 🇲🇽 y El Salvador 🇸🇻 —en los que participa ilegalmente el actual mandatario— y los municipales en Costa Rica 🇨🇷.

Además, el riesgo de la difusión de imitaciones aumenta si observamos en nuestra región a los muchos gobiernos autoritarios, cuyos actores estarán gustosos de manipular el debate público digital. Ahora tienen más elementos a la mano para lograrlo 🙄.

Entonces en esta edición:

🚩Presento algunos ejemplos de usos nocivos de deepfakes en Latam.

🚨Explico por qué los deepfakes son un reto para los verificadores y las plataformas sociales.

🍀Comparto casos en los que se ha usado la IA para reducir costos en campañas de cambio social 🎉, y cierro con dos noticias y un recurso inspirador sobre redes sociales.

Si alguien te compartió este contenido, puedes suscribirte para que llegue directamente a tu correo electrónico 📬. Lo envío cada dos meses.

[Red Flags] 🚩🚩

En las últimas semanas, en Reino Unido, Eslovaquia, Nigeria, entre otros países, se han presentado casos en donde imágenes y/o audios al parecer manipulados se emplean para simular declaraciones comprometedoras de políticos y reforzar sesgos sobre ellos.

Lamentablemente, también se han registrado intentos similares de enturbiar debates electorales nacionales y locales 🗳️ en Latinoamérica:

🚩En Colombia 🇨🇴, durante la campaña para las elecciones regionales de octubre, se distribuyeron audios que imitaban las voces de candidatos a alcaldías municipales. Además, hicieron el montaje de una transmisión noticiosa para insinuar falsamente una relación entre un candidato y un grupo armado ilegal. De esa forma no solo se distorsionó la realidad sobre los postulantes, sino sobre las voces expertas de los periodistas.

🚩En México 🇲🇽 ocurrió otro incidente que generó confusión. A finales de octubre, circuló un audio aparentemente con la voz de Martí Batres, jefe de gobierno de la Ciudad de México. Allí se le oye dándole instrucciones a un grupo de periodistas para desacreditar a Omar García Harfuch, quien en ese momento buscaba ser candidato a la jefatura de gobierno de la capital. Batres alegó que el audio fue fabricado con inteligencia artificial.

La difusión de este material desató un intenso debate sobre la naturaleza del audio: ¿era un deepfake o una grabación auténtica? Ambas partes respaldaron sus argumentos con declaraciones de expertos en análisis de datos y académicos, además de resultados de distintos programas de detección de deepfakes, los cuales arrojaron conclusiones contradictorias.

Al final, no quedó claro si el audio fue una creación sintética o si Batres se dedicó a desmentir declaraciones inconvenientes 🤷🏿♀️.

Este ejemplo ilustra el doble riesgo que representa la proliferación de herramientas que permiten imitar a las personas: hacerles creer a los usuarios hechos que no ocurrieron o llevarlos a descartar la evidencia real, tal como está pasando con la información sobre el conflicto entre Israel 🇮🇱 y Palestina 🇵🇸, según The New York Times.

Así explica el problema Ana María Saavedra, directora del medio de verificación Colombiacheck:

Existe una gran problemática con la inteligencia artificial, que me recuerda al cuento del pastorcito mentiroso y el lobo. Por un lado, hemos visto cómo la IA se utiliza para crear videos y especialmente audios falsos con el fin de desinformar. Pero, por otro lado, hemos visto situaciones en las que se revelan audios auténticos de personas y surge la excusa: 'Eso no lo dije yo, es obra de la inteligencia artificial'. Este panorama plantea un desafío porque faltan criterios claros que nos permitan discernir cuándo un audio es generado por IA, cuándo es imitación, cuándo es auténtico o simplemente de mala calidad.

Al analizar los casos, para indicar que los contenidos tienen señales de posibles manipulaciones, los verificadores de hechos se han basado hasta el momento en detalles y sutilezas. Sin embargo, el análisis de audios representa el mayor desafío 🔉. Incluso para los más experimentados es difícil confirmar de manera definitiva y rápida si son deepfakes, debido a la falta de herramientas de detección abiertas y exactas, así como a la variedad de métodos de manipulación posterior de audios. La certeza definitiva será aún más esquiva a medida que avance la sofisticación en la producción del contenido.

[Qué onda con las plataformas] 🚨

¿Qué están haciendo las empresas de IA y las redes sociales para moderar y facilitar la identificación de deepfakes? Mientras la tecnología para crear material con IA va volando 🚀, las herramientas para identificarlo están muy rezagadas. Esto es lo que tenemos hasta ahora:

🚨ChatGPT y Dall-E, entre otras plataformas, prohíben la creación de imágenes de políticos o figuras públicas. Asimismo, estas herramientas restringen los contenidos sexuales o violentos. Sin embargo, hay numerosos reportes de usuarios que logran sortear estas restricciones usando trampas lógicas o encontrando fallas en la aplicación de las políticas. En las presidenciales argentinas se usaron herramientas con IA para la producción de material publicitario y de contenidos engañosos.

🚨En cuanto a las redes sociales, sus políticas en general dicen apuntarle a etiquetar el contenido artificial y a la eliminación cuando se produce con fines de confundir al público.

TikTok exige la identificación clara de contenidos creados o manipulados que muestren escenas que puedan parecer reales. Además, prohíbe la divulgación de este tipo de materiales cuando violen alguna otra política (como discurso de odio o explotación sexual).

Meta dice que eliminará los contenidos que puedan engañar a los usuarios al hacerles creer que alguien dijo “palabras que no ha pronunciado” o que un video es auténtico. ¿La excepción? La parodia y la sátira. Además, dice que a partir de 2024 les exigirá a los anunciantes de temas políticos y sociales reportar cuando utilicen IA para representar personas o hechos.

X publicó una política similar a la de Meta.

YouTube, por su parte, el 14 de noviembre anunció que “en los próximos meses” hará actualizaciones para pedirle a los creadores reportar cuando hayan producido con IA contenido que parece real.

Habrá que esperar a que las plataformas cumplan efectivamente con sus políticas de integridad. No siempre lo hacen.

[Da esperanza] 🍀

Como mencioné arriba, las herramientas de IA no solo se están usando para propósitos dañinos. Son una alternativa para abaratar costos de producción de contenidos de buena calidad, así como construir imágenes inexistentes y mundos posibles:

🍀Gracias a la IA nació Hope Sogni, una candidata ficticia a la presidencia de la FIFA, que fue construida usando las voces 🎤 y experiencias de mujeres influyentes en el deporte. La intención: mostrar que el fútbol puede ser dirigido de manera diferente y que las mujeres no deberíamos ser rarezas en las posiciones de poder en los deportes.

🍀Y la iniciativa Entre Ríos Museo generó arte con inteligencia artificial para producir una animación metafórica sobre la violencia contra decenas de profesores en el Caribe colombiano.

Aunque ahora no tenemos suficientes elementos para afrontar el fenómeno de los deepfakes, como sociedad civil podemos seguir apostándole a la construcción de confianza, de vínculos y de conversaciones menos polarizantes en línea 🫂. Los sesgos pueden hacer que las personas sean más susceptibles a creer en contenido engañoso.

🍀Así lo hicieron los panameños, quienes protestaron durante más de un mes contra la renovación —sin suficiente consulta ciudadana— de un contrato que permitía la explotación de la mayor mina de cobre a cielo abierto de Centroamérica. El 28 de noviembre, lograron que la Corte Suprema de Justicia declarara inconstitucional esa concesión estatal 🪩💃🏽.

Durante estas movilizaciones, vi en Instagram un comportamiento de los usuarios muy interesante 📱. Creadores de contenido de noticias, humor, activismo ambiental, consejos de belleza, trading, música, baile, ilustración, así como cuentas de pueblos indígenas, políticos, empresas de tours turísticos y hasta de repuestos para electrodomésticos difundieron contenidos en apoyo a las protestas.

De esa forma, lograron crear una comunidad narrativa en donde cada quien, a su manera y con su estilo, contó historias sobre por qué es importante defender la naturaleza y a las comunidades y rechazar el extractivismo y la corrupción.💡Este tipo de distribución de contenido es una manera de hackear la fragmentación de las audiencias digitales💡.

🍀Recomiendo este artículo de The MarkUp (en inglés) sobre “la abuela vietnamita que lucha contra la desinformación, un video de YouTube a la vez” ❤️. Bùi Như Mai, una jubilada, desde 2016 empezó a notar que sus amigos recibían mucha información errónea de derecha en su idioma, especialmente a favor de Donald Trump. Ahora, ella traduce y lee frente a la cámara artículos de medios como The Atlantic y The New York Times en vietnamita para “llevar noticias legítimas” a su “comunidad”. En la publicación, podrán verla traduciendo mientras cuida de su nieto 👶🏽.

🍀Finalmente, no pueden dejar de consultar los tres fanzines contra la desinformación y discursos de odio hechos por El Surtidor y Emancipa, en Paraguay 🇵🇾. Tienen información sobre cómo las alianzas, el periodismo y el amor pueden desarmar el odio. ¡Se pueden imprimir y compartir!

Anuncio comunitario

Este año abrimos una convocatoria para que las organizaciones que nos leen solicitaran investigaciones digitales.

De la mano del medio salvadoreño Malayerba, analizamos la diseminación del discurso de seguridad punitiva del presidente de El Salvador, Nayib Bukele, en otros países de Latam. Acompañamos al Centro de Derechos de Mujeres de Honduras a explorar las narrativas sobre la pastilla anticonceptiva de emergencia 💊 y los vacíos informativos de aquellas que buscan este medicamento en línea. Así mismo, hicimos una investigación en Twitter sobre las narrativas estigmatizantes sobre la población LGBTI en Guatemala 🇬🇹.

En 2024, volveremos a abrir nuestro buzón 📭 para que nos hagan llegar sus necesidades de investigación.

¡Gracias por leerme! 😊

¡Hasta la próxima! 📩

¿Te gustó este boletín? ¿Tienes dudas? Puedes dejarlas en el área de comentarios de esta publicación en Substack o enviarlas a boletines@inspiratorio.org.

¿Conoces a alguien a quien le pueda interesar recibir este boletín? Compártele este formulario de suscripción.

Edición: Koleia Bungard y Cristina Vélez Vieira / Diseño: Emii